Alibaba Cloud ra mắt QwQ-32B: Mô hình suy luận nhỏ gọn với hiệu suất tiên tiến

Mới đây, Alibaba Cloud – nhánh điện toán đám mây của tập đoàn Alibaba – đã chính thức giới thiệu mô hình Qwen-32B-Instruct, còn được gọi là QwQ-32B. Đây là một mô hình ngôn ngữ có kích thước trung bình nhưng được tối ưu hóa mạnh mẽ cho các tác vụ suy luận (inference) với hiệu suất vượt trội so với nhiều đối thủ trong cùng phân khúc.

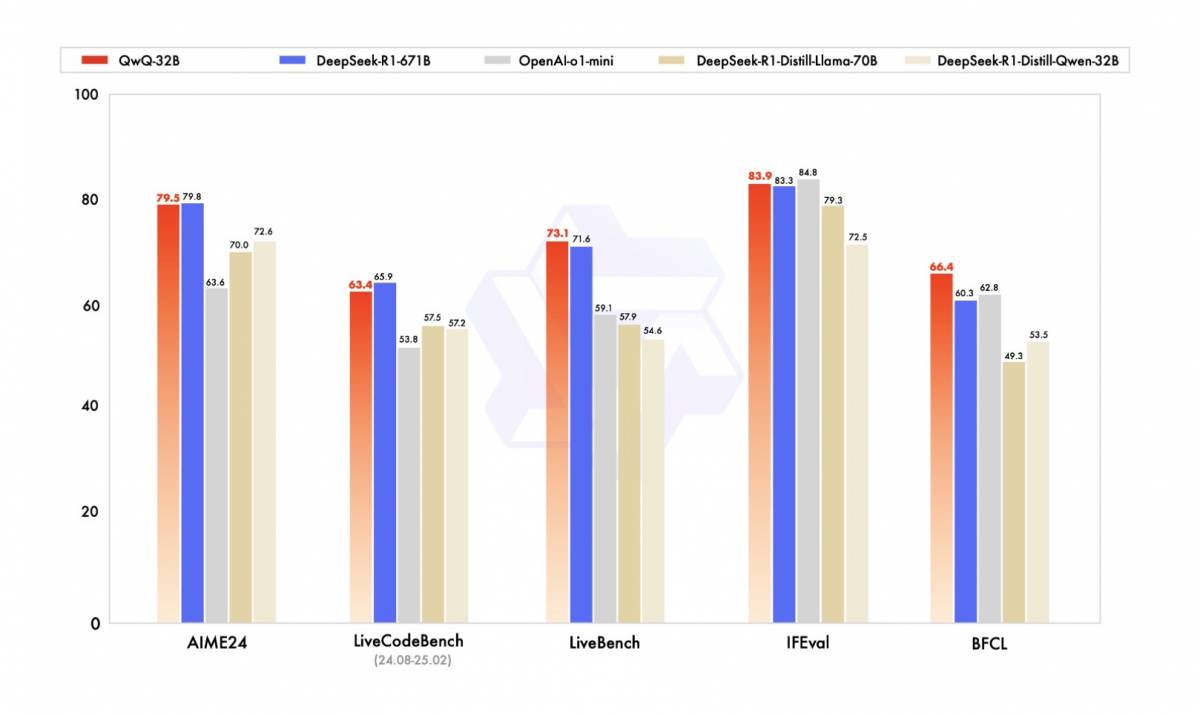

Được xây dựng trên Qwen2.5-32B, mô hình ngôn ngữ lớn mới nhất của Alibaba Cloud với số lượng tham số chính xác, QwQ-32B vượt trội trên nhiều chuẩn mực khác nhau, bao gồm AIME 24 (lý luận toán học), Live CodeBench (năng lực lập trình), LiveBench (kiểm tra bộ dữ liệu và đánh giá khách quan), IFEval (khả năng làm theo hướng dẫn) và BFCL (khả năng gọi công cụ và hàm).

Mở rộng quy mô học tăng cường để tăng cường khả năng lý luận

Hiệu suất đặc biệt của QwQ-32B làm nổi bật sức mạnh của Reinforcement Learning (RL), kỹ thuật cốt lõi đằng sau mô hình, khi áp dụng cho một mô hình nền tảng mạnh mẽ như Qwen2.5-32B, được đào tạo trước trên kiến thức thế giới rộng lớn.

Bằng cách tận dụng khả năng mở rộng RL liên tục, QwQ-32B chứng minh những cải tiến đáng kể về khả năng lập luận toán học và mã hóa.

Ngoài ra, mô hình được đào tạo bằng cách sử dụng phần thưởng từ mô hình phần thưởng chung và các trình xác minh dựa trên quy tắc, nâng cao khả năng chung của nó. Những khả năng này bao gồm việc tuân theo hướng dẫn tốt hơn, phù hợp với sở thích của con người và cải thiện hiệu suất của tác nhân.

Đọc thêm: LangChain là gì? Cách ứng dụng AI với LLM

Tích hợp khả năng của tác nhân để suy luận nâng cao

Nhóm nghiên cứu cũng đã tích hợp các khả năng liên quan đến tác nhân vào QwQ-32B, cho phép nó suy nghĩ phản biện, sử dụng các công cụ hiệu quả và điều chỉnh lý luận của mình dựa trên phản hồi của môi trường.

Nhóm nghiên cứu cũng đang khám phá thêm việc tích hợp các tác nhân với RL để cho phép lý luận đường chân trời dài, nhằm mục đích mở khóa trí thông minh lớn hơn nữa thông qua việc mở rộng quy mô thời gian suy luận.

QwQ-32B hiện có sẵn dưới dạng mô hình mã nguồn mở trên Hugging Face và Model Scope theo giấy phép Apache 2.0, cho phép tải xuống miễn phí. Nó cũng có thể truy cập thông qua Qwen Chat . Nhờ chi phí triển khai giảm đáng kể, mô hình có thể được triển khai hiệu quả trên phần cứng cấp độ người tiêu dùng.